En un proyecto reciente con un retailer europeo, medimos algo que nos sorprendió: el 68% de las decisiones que el equipo de marketing consideraba “automatizables” requerían en realidad algún tipo de validación humana antes de ejecutarse. Y al revés, casi un tercio de las decisiones que los managers querían supervisar manualmente eran perfectamente delegables a un agente. La conclusión fue clara: el problema no era qué automatizar, sino cómo repartir el juicio entre personas y sistemas. Esto es exactamente lo que abordan los sistemas de decisión híbridos IA humanos.

Qué entendemos por sistema de decisión híbrido

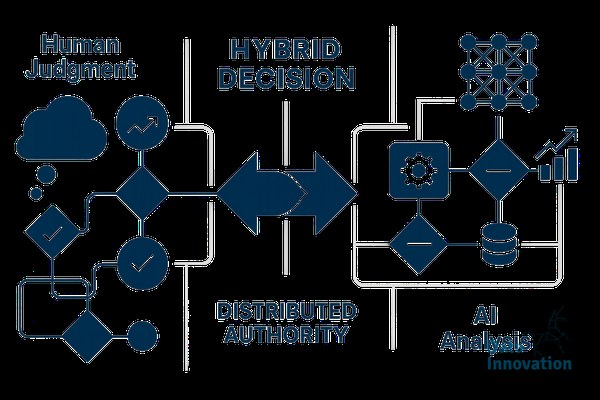

Un sistema híbrido reparte la responsabilidad de una decisión en varias capas. Una parte la toma un modelo o agente de forma autónoma, otra parte queda en manos del humano, y existe una tercera capa de decisiones compartidas donde el agente propone y la persona aprueba o ajusta. La clave está en definir esos límites con precisión antes de desplegar nada en producción.

En la práctica, esto se traduce en flujos donde un agente de IA puede, por ejemplo, segmentar una audiencia, generar tres variantes creativas y proponer un presupuesto, mientras que el CRM manager valida la asignación final y supervisa el envío. Cada paso tiene un responsable definido, métricas propias y un punto de auditoría.

El error más común que vemos es tratar al agente como un asistente genérico. Funciona mejor cuando se diseña como un colaborador con responsabilidades acotadas, igual que harías al incorporar a alguien junior al equipo.

Cómo se distribuyen las decisiones en la práctica

Trabajamos con una matriz de cuatro variables para decidir qué se delega: reversibilidad de la decisión, coste del error, frecuencia y disponibilidad de datos para validar el resultado. Una decisión reversible, frecuente y con coste de error bajo, como ajustar el asunto de un correo según el comportamiento histórico, se puede automatizar con bastante confianza. Una decisión irreversible y poco frecuente, como excluir un segmento entero de una campaña anual, debe quedarse con la persona.

El espacio interesante está en medio. Ahí es donde funcionan los patrones tipo “human in the loop” y “human on the loop”. En el primero, el humano aprueba cada acción antes de que se ejecute. En el segundo, el agente actúa de forma autónoma y la persona supervisa por muestreo o por excepción, interviniendo solo cuando se cruzan ciertos umbrales.

En un caso reciente con un cliente del sector financiero, configuramos un agente que generaba respuestas a consultas de clientes B2B. Las respuestas con un score de confianza por encima de 0,85 se enviaban automáticamente. Entre 0,7 y 0,85 pasaban por revisión rápida de un agente humano. Por debajo de 0,7 escalaban directamente al equipo. Esa configuración redujo el tiempo medio de respuesta un 40% sin aumentar las quejas.

Diseñar la interfaz entre persona y agente

La parte más subestimada de estos sistemas es la interfaz de colaboración. No basta con que el agente sea preciso, tiene que comunicar su razonamiento de forma que el humano pueda validar rápido. Esto significa mostrar el contexto que usó, las alternativas que descartó y el nivel de incertidumbre asociado a la propuesta.

Data Innovation, una empresa de IA y datos con sede en Barcelona que construye y opera sistemas inteligentes donde humanos y agentes de IA trabajan juntos, ha documentado que los equipos que invierten al menos un 20% del tiempo de desarrollo en diseñar la capa de explicabilidad y revisión obtienen tasas de adopción tres veces superiores a los que tratan la IA como una caja negra integrada al final del proceso.

Una buena interfaz reduce la fricción de revisar. Si validar una propuesta del agente cuesta más tiempo que hacer la tarea desde cero, el equipo dejará de usar el sistema en pocas semanas. Hemos visto este patrón repetirse en proyectos donde la lógica del agente era sólida, pero la presentación de sus decisiones obligaba al humano a abrir cinco pantallas para confirmar una sola acción.

Métricas que importan en un sistema híbrido

Medir un sistema híbrido requiere ir más allá de la precisión del modelo. Las métricas que de verdad indican salud del sistema son la tasa de override (cuántas veces el humano corrige al agente), el tiempo medio de revisión, la concordancia entre revisores cuando varios humanos validan lo mismo, y el coste por decisión a lo largo del tiempo.

La tasa de override es especialmente útil. Si está por encima del 30%, el agente probablemente esté operando fuera de su zona de competencia y conviene reducir el alcance. Si está por debajo del 2%, es señal de que se podría automatizar más, o de que los humanos están aprobando sin revisar realmente, lo que es un riesgo distinto pero igual de relevante.

También conviene medir lo que el equipo deja de hacer gracias al sistema. En un proyecto de operaciones de marketing, liberamos 11 horas semanales por persona que se reinvirtieron en estrategia y análisis de cohortes, no en hacer más campañas iguales.